17% des Suisses utilisent déjà l’IA — et vous ?

Selon l’étude Comparis de novembre 2023, 17% de la population suisse utilise régulièrement des outils d’intelligence artificielle comme ChatGPT ou Microsoft Copilot. Ce chiffre peut sembler modeste. Il ne l’est pas.

En comparaison, quand Internet est arrivé en Suisse dans les années 90, il a fallu près de 5 ans pour atteindre un taux d’adoption similaire. L’IA a mis moins d’un an pour toucher un Suisse sur six. Et la courbe ne fait qu’accélérer.

La question n’est plus “est-ce que l’IA va changer notre société ?” — c’est déjà fait. La vraie question est : qui décide des règles du jeu ?

Qui utilise l’IA en Suisse ? Les chiffres

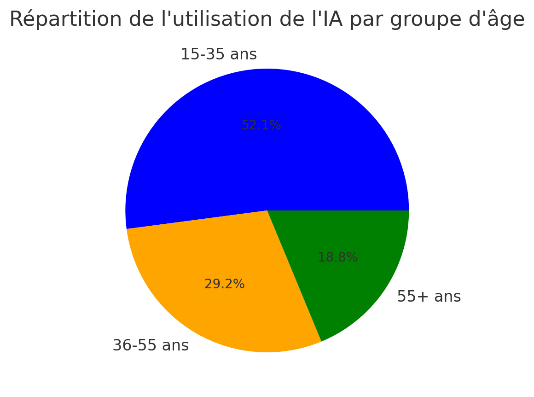

Par tranche d’âge

Les chiffres sont sans appel :

- 15-35 ans : 52.1% — plus de la moitié des jeunes utilisent déjà l’IA

- 36-55 ans : 29.2% — près d’un tiers des actifs

- 55 ans et plus : 18.8% — adoption non négligeable chez les seniors

Ce qui frappe, c’est que les 15-35 ans représentent plus de la moitié des utilisateurs. Cette génération ne se demande pas si elle va utiliser l’IA — elle l’utilise déjà pour étudier, travailler, créer. C’est un fait accompli.

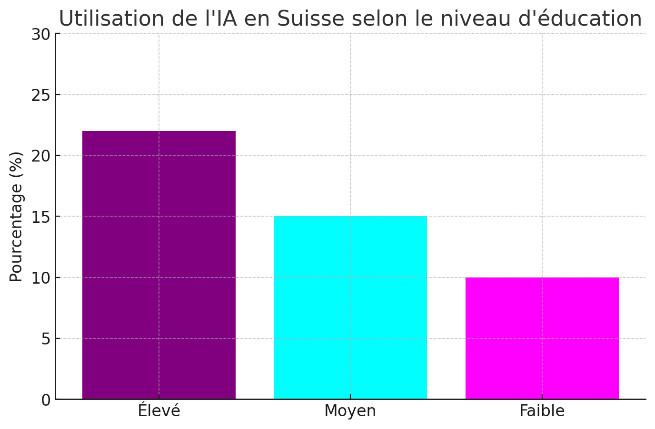

Par niveau de formation

L’étude Comparis révèle une corrélation directe entre le niveau d’éducation et l’adoption de l’IA :

- Formation élevée : 22% — les diplômés du supérieur sont les plus grands utilisateurs

- Formation moyenne : 15%

- Formation faible : 10%

Ce fossé éducatif pose une question fondamentale : l’IA va-t-elle creuser les inégalités ? Si seuls ceux qui ont accès à une bonne formation savent tirer parti de l’IA, on crée une société à deux vitesses — ceux qui utilisent l’IA pour avancer, et ceux qui sont laissés pour compte.

C’est exactement pour cela que j’ai écrit mon article sur l’apprentissage de l’informatique avec l’IA : il faut démocratiser ces compétences, pas les réserver à une élite.

La confiance : le vrai problème

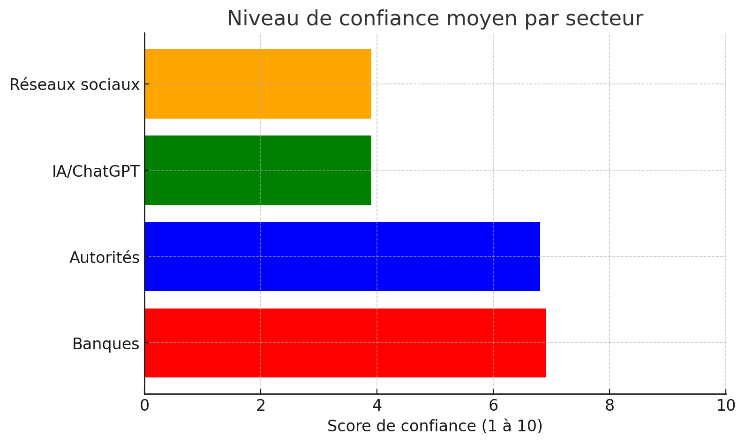

À qui les Suisses font-ils confiance ?

L’indice de confiance numérique Comparis 2023 est révélateur. Sur une échelle de 1 à 10 :

- Banques et autorités : ~7/10 — confiance élevée

- IA et ChatGPT : ~4/10 — méfiance

- Réseaux sociaux : ~4/10 — méfiance similaire

Les Suisses font confiance à leurs banques et à l’État. Ils ne font pas confiance à l’IA. Et honnêtement ? Ils ont des raisons.

Pourquoi cette méfiance est rationnelle

La méfiance envers l’IA n’est pas de l’ignorance. C’est une réaction saine face à plusieurs réalités :

-

Les données partent aux États-Unis. Quand vous utilisez ChatGPT, vos données sont traitées par OpenAI, une entreprise américaine soumise au CLOUD Act. Le gouvernement américain peut légalement accéder à vos données, même si vous êtes en Suisse.

-

Les modèles sont des boîtes noires. Personne — pas même les créateurs — ne peut expliquer exactement pourquoi un modèle génère telle réponse plutôt qu’une autre. C’est un problème fondamental pour la transparence.

-

Les biais existent. Les modèles d’IA reproduisent et amplifient les biais présents dans leurs données d’entraînement. Un outil utilisé pour le recrutement, le crédit, ou la justice peut discriminer sans que personne ne s’en rende compte.

-

Le consentement est flou. Quand vous tapez une question dans ChatGPT, savez-vous exactement ce qui arrive à cette donnée ? Est-elle utilisée pour entraîner le modèle ? Stockée combien de temps ? Accessible à qui ?

Ce que dit la loi — LPD et RGPD

La LPD suisse (entrée en vigueur le 1er septembre 2023)

La nouvelle Loi fédérale sur la Protection des Données (nLPD) a modernisé le cadre juridique suisse. Points clés :

- Principe de proportionnalité : on ne collecte que les données nécessaires

- Droit à l’information : tout traitement de données doit être transparent

- Droit d’accès et de suppression : chaque personne peut demander ses données ou leur effacement

- Annonce des violations : obligation de notifier le PFPDT en cas de fuite de données

- Sanctions : amendes jusqu’à 250'000 CHF pour les personnes physiques responsables

La LPD s’applique à toute entreprise traitant des données de personnes en Suisse — y compris les outils d’IA.

Le RGPD européen

Si vous avez des clients ou visiteurs dans l’UE, le RGPD s’applique aussi. Amendes jusqu’à 20 millions d’euros ou 4% du chiffre d’affaires mondial. Google, Meta et Amazon ont déjà payé des milliards.

Le problème concret

Imaginons une PME suisse qui utilise ChatGPT pour rédiger des réponses à ses clients. Les données clients (noms, emails, demandes) sont envoyées à OpenAI. Questions :

- Le client a-t-il donné son consentement explicite ?

- L’entreprise a-t-elle mentionné ce traitement dans sa politique de confidentialité ?

- Les données sont-elles traitées dans un pays avec un niveau de protection adéquat (décision du Conseil fédéral) ?

- En cas de fuite chez OpenAI, qui est responsable ?

La plupart des PME ne se posent même pas ces questions. Et c’est là que le bât blesse.

Le choix politique : souveraineté vs. innovation

Position 1 : “Laissez faire le marché”

Certains argumentent que trop de régulation étoufferait l’innovation. La Suisse, avec ses EPF et sa tradition d’excellence technologique, devrait laisser les entreprises expérimenter librement avec l’IA pour ne pas prendre de retard.

Mon avis : c’est séduisant mais naïf. “L’innovation” sans cadre, c’est ce qui a donné Facebook, Cambridge Analytica, et la manipulation d’élections. On a vu ce que ça donne.

Position 2 : “Régulons comme l’Europe”

L’EU AI Act, adopté en 2024, classe les systèmes d’IA par niveaux de risque et interdit certains usages (score social, reconnaissance faciale de masse). Certains veulent que la Suisse adopte un cadre similaire.

Mon avis : c’est la bonne direction, mais l’Europe a tendance à sur-réguler. La Suisse a l’opportunité de trouver un équilibre — un cadre clair qui protège les citoyens sans enterrer les startups sous la paperasse.

Position 3 : “Construisons notre propre IA”

La Suisse pourrait investir dans des modèles d’IA souverains, hébergés en Suisse, soumis au droit suisse. L’EPFL et l’ETHZ ont les compétences. Le Swiss National Supercomputing Centre (CSCS) a l’infrastructure.

Mon avis : c’est la piste la plus intéressante à long terme. Si nos données restent en Suisse, traitées par des systèmes suisses, soumis à la LPD — le problème de confiance disparaît en grande partie. C’est d’ailleurs pour cela que j’utilise Euria, une IA européenne, pour mes tâches quotidiennes : la souveraineté des données compte.

Ce que je fais concrètement

En tant que développeur de business numérique, voici mes choix :

-

Transparence totale. Mes clients savent que j’utilise l’IA. C’est dans ma communication, sur mon site. Je n’ai rien à cacher.

-

Outils choisis avec soin. J’utilise Claude (Anthropic) pour le développement technique — c’est le meilleur outil que j’ai trouvé pour les projets complexes. Et Euria pour le quotidien — parce que c’est européen et que les données restent en Europe.

-

Conformité LPD/RGPD. Mon site a une politique de confidentialité, un consentement cookies, et aucune donnée n’est envoyée à des tiers sans raison. C’est le minimum — et pourtant, la majorité des sites suisses ne le font pas.

-

Formation continue. Je me forme sur les fondamentaux (DNS, serveurs, sécurité) parce que l’IA ne remplace pas la compétence — elle l’augmente.

La vraie menace n’est pas l’IA

La vraie menace, ce n’est pas l’intelligence artificielle elle-même. C’est l’ignorance face à l’IA.

- L’ignorance des citoyens qui ne comprennent pas ce qui arrive à leurs données

- L’ignorance des entreprises qui utilisent l’IA sans cadre ni réflexion

- L’ignorance des politiques qui légifèrent sur des technologies qu’ils ne maîtrisent pas

- L’ignorance des utilisateurs qui délèguent tout à l’IA sans comprendre ce qu’elle fait

L’IA est un outil extraordinaire. Je le constate tous les jours dans mon travail. Elle accélère, elle augmente, elle rend possible ce qui ne l’était pas. Mais un outil sans connaissance, c’est un danger.

Mon message : formez-vous. Comprenez les bases. Exigez la transparence. Choisissez vos outils avec discernement. Et surtout — ne laissez personne décider pour vous de ce que l’IA fait avec vos données.

La Suisse a toujours su trouver l’équilibre entre innovation et protection. C’est dans notre ADN. Il est temps d’appliquer cette sagesse à l’intelligence artificielle.

Sources

- Comparis.ch — Étude “Utilisation de l’IA en Suisse”, novembre 2023

- Comparis.ch — Indice de confiance numérique 2023

- Confédération suisse — Nouvelle Loi fédérale sur la Protection des Données (nLPD), 1er septembre 2023

- Union européenne — EU AI Act, adopté mars 2024

- PFPDT — Préposé fédéral à la protection des données et à la transparence, recommandations IA 2024

Cet article est basé sur une analyse que j’ai rédigée dans le cadre de ma formation au CHUV/EPSIC, enrichie et mise à jour. Les données Comparis datent de 2023 — l’adoption a probablement augmenté depuis.

Vous voulez discuter de l’IA et de la protection des données pour votre entreprise ? Réservez une consultation gratuite.